Aujourd’hui, OpenAI a changé de vitesse pour se concentrer sur les développeurs, en annonçant de grandes mises à jour de ses API et en affinant ses modèles. Si vous créez des applications avec les modèles OpenAI, cette journée pourrait bien être votre préférée. Voici un aperçu étape par étape de tout ce qu’OpenAI a dévoilé lors de cette journée de développement.

1. Le modèle o1 est ici

Jusqu’à présent, nous avions accès à l’API o1-Preview. Cependant, avec la sortie du modèle o1, OpenAI fournit également un support API.

Alors, quoi de neuf dans o1 ?

- C’est beaucoup plus intelligent et plus précis. Il peut gérer des tâches complexes étape par étape avec de bonnes capacités de raisonnement, comme coder un programme compliqué, prévoir des finances ou analyser des documents confus.

- Il peut désormais formater les réponses au format JSON, ce qui est incroyablement utile pour les développeurs qui créent des applications nécessitant des données propres et structurées.

- o1 s’intègre également à des outils et des API externes, ce qui lui permet d’extraire de manière transparente des données en direct telles que des mises à jour météorologiques ou des cours des actions.

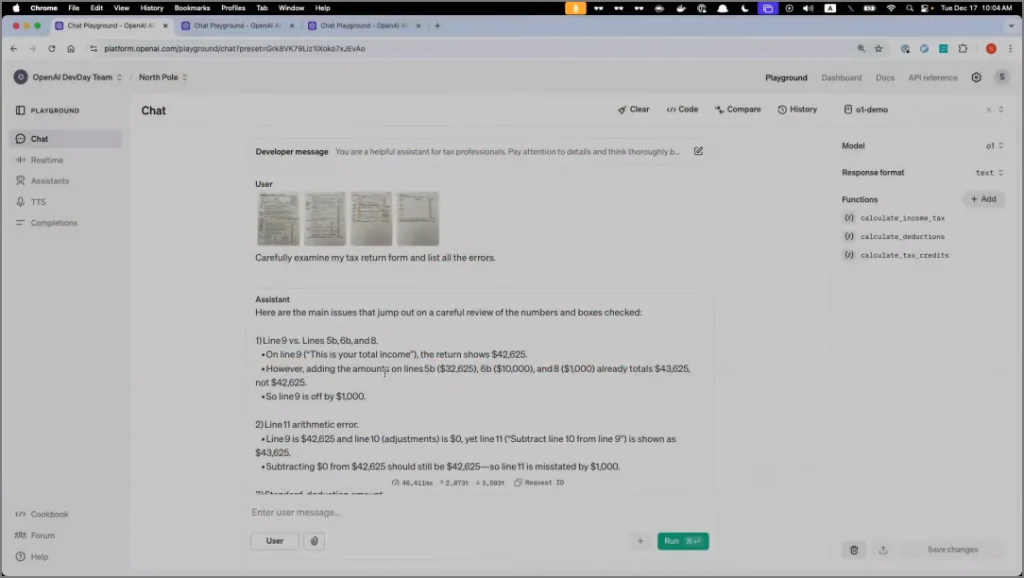

- o1 peut « voir » des images. Par exemple, si vous téléchargez un formulaire fiscal, il peut l’analyser, repérer les erreurs et les expliquer.

- Enfin, vous pouvez contrôler les efforts que vous consacrez à la réflexion. Pour les tâches rapides, il répond plus rapidement. Pour les problèmes plus complexes, il faut du temps pour apporter de meilleures réponses.

OpenAI affirme que o1 est 60 % plus efficace que la version d’aperçu, ce qui signifie des résultats plus rapides tout en utilisant moins de jetons (et en réduisant les coûts).

Vous pouvez commencer à utiliser o1 immédiatement si vous êtes déjà sur l’API OpenAI. Plan d’utilisation de niveau 5. Pour d’autres, OpenAI indique qu’il se déploie progressivement.

2. L’API en temps réel bénéficie de mises à niveau majeures

Créer des applications en temps réel est devenu plus simple. OpenAI a annoncé des améliorations majeures de son API en temps réel, en mettant l’accent sur la vitesse, la prise en charge vocale et la rentabilité.

Voici les faits saillants :

- L’API d’OpenAI prend désormais en charge WebRTC, ce qui rend les appels vocaux et vidéo en temps réel plus fluides. Il est parfait pour créer des outils tels que des assistants vocaux, des applications vidéo ou des appareils IoT nécessitant des réponses en temps réel.

- Voici une bonne nouvelle. Les coûts audio pour GPT-4o ont été réduits de 60 %. Si vous utilisez des entrées audio mises en cache, c’est encore moins cher, en baisse de 87,5 %.

- OpenAI a également lancé GPT-4o Mini, une version plus petite et moins chère de GPT-4o pour les tâches en temps réel. Il est rentable mais suffisamment puissant pour des éléments tels que les assistants virtuels et autres applications vocales.

Lire aussi :

3. Ajustement des préférences : personnalisez votre IA

Pour les développeurs qui souhaitent des modèles adaptés à leurs besoins spécifiques, OpenAI a annoncé Preference Fine-Tuning. Cette méthode vous permet de personnaliser les modèles en leur apprenant ce qui est « préféré » et ce qui ne l’est pas. Par exemple, si vous créez une application d’écriture créative, vous pouvez proposer deux versions, une avec votre ton et votre style préférés et celle que vous n’aimez pas. Le modèle apprend en comparant deux versions.

4. Go et les SDK Java arrivent (bêta)

Pour les développeurs qui codent en Go ou Java, OpenAI vous simplifie la vie. Ils ont lancé des SDK officiels pour les deux langages, rejoignant leurs bibliothèques Python, Node.js et .NET existantes. Ces SDK simplifient la façon dont vous vous connectez à l’API d’OpenAI dans les applications Go ou Java.

Alors, qu’est-ce que cela signifie pour vous ?

Si vous êtes un développeur ou quelqu’un qui construit avec OpenAI, les mises à jour d’aujourd’hui apportent beaucoup de choses :

- o1 est là et prêt pour des tâches complexes.

- Les outils vocaux en temps réel sont moins chers et plus faciles à créer.

- La personnalisation des modèles est désormais plus flexible grâce au réglage précis des préférences.

- Les nouveaux SDK signifient un développement plus rapide en Go et Java.

Le jour 9 était entièrement consacré aux développeurs, donc cela n’aurait peut-être pas été aussi excitant pour les utilisateurs réguliers. Mais alors qu’il ne reste que 3 jours, le Jour 10 pourrait apporter quelque chose à tout le monde. Nous sommes impatients de voir si les rumeurs concernant GPT-4.5, le modèle Operator et d’autres surprises s’avèrent vraies.